深入理解 AI 基础设施:液冷、服务器与光模块美股细分赛道梳理

Image Source: unsplash

AI基础设施正成为全球科技产业变革的核心驱动力。液冷技术在数据中心的应用逐步加速,过去五年间,液冷服务器市场规模持续扩大,2024年中国液冷服务器市场预计达到201亿元美元,渗透率有望从5%提升至未来三到五年的30%-40%。服务器算力需求持续爆发,推动高性能计算架构迭代。光模块领域,国际竞争格局日益激烈,技术创新催生新一轮产业升级。冷板式液冷优先推广、液冷经济性、AI芯片多元化以及光模块超级周期,均成为行业关注的关键要素。

核心要点

- 液冷技术以液体为冷却介质,能效显著高于风冷,成为数据中心散热的主流选择。

- 服务器技术持续演进,采用高性能芯片以满足AI工作负载的需求,推动整体算力提升。

- 光模块技术快速迭代,800G和1.6T模块成为主流,满足AI模型对带宽的高要求。

- 投资AI基础设施需关注市场扩张与技术创新,同时警惕供应链风险与政策变化。

- 选择高效的金融服务平台可提升跨境资金调度效率,助力企业在全球市场中灵活应对。

对于这类涉及跨境采购、设备结算与海外项目投入的赛道,资金调度效率往往会直接影响执行节奏。若企业或投资者同时关注项目付款、换汇成本与相关标的跟踪,可借助 BiyaPay 这类多资产交易钱包统一处理相关环节,例如使用官网的汇率查询与对比工具查看不同法币之间的换算成本,并通过股票信息查询继续跟踪美股相关公司动态。

BiyaPay 也提供国际汇款等跨境资金服务,并在美国和新西兰等地具备相应合规资质,适合放在基础设施出海、设备采购和跨市场资金安排的语境下理解;但平台不提供可自动识别市场信号或替用户执行交易的AI系统,具体决策仍需结合企业自身预算、采购周期和研究判断。

液冷赛道

液冷技术原理

- 液冷技术以液体为冷却介质,具备远高于空气的载热和导热能力。

- 换热效率约为风冷的20倍,显著提升数据中心散热效率。

- 该技术有助于降低能耗,提升AI基础设施的整体运行效率。

冷板式与浸没式对比

| 冷板液冷 | 浸没液冷 |

|---|---|

| 成本较低,易于服务和改造 | 成本较高,维护复杂 |

| 兼容现有数据中心基础设施 | 提供卓越的热性能 |

| 适合现场维护,无需系统停机 | 整个服务器浸入冷却液,消除热点 |

冷板式液冷因其改造便捷、成本优势和对现有数据中心的兼容性,成为当前优先推广的主流方案。

产业链结构

液冷产业链涵盖冷却液、冷板、泵阀、管路、系统集成与运维服务等环节。BiyaPay为全球AI基础设施企业提供高效的收付款、国际汇款及数字货币实时兑换服务,助力企业在美股及港股市场实现资金灵活调度,满足跨境采购和项目建设的多元化需求。

美股主要公司

- Vertiv

- Asetek

- CoolIT Systems

- LiquidStack

这些公司专注于液冷系统研发、制造及集成,持续推动液冷技术在AI基础设施中的应用落地。

市场空间与经济性

| 年份 | 市场规模 (亿美元) | 年均增长率 (CAGR) |

|---|---|---|

| 2026 | 6 | 18.2% |

| 2035 | 27.1 | 18.2% |

- AI工作负载持续增长,推动高密度冷却解决方案需求上升。

- 可持续性法规和能效要求加速液冷替代风冷趋势。

- 液冷服务器PUE值可低至1.15,远优于传统风冷服务器的1.35,10MW数据中心每年可节省超200万美元电费。

- 液冷系统初始投资虽高于风冷,但能耗节省带来2-3年回报周期。

液冷技术正从“可选”转变为“必选”,成为AI基础设施高效、可持续发展的关键支撑。

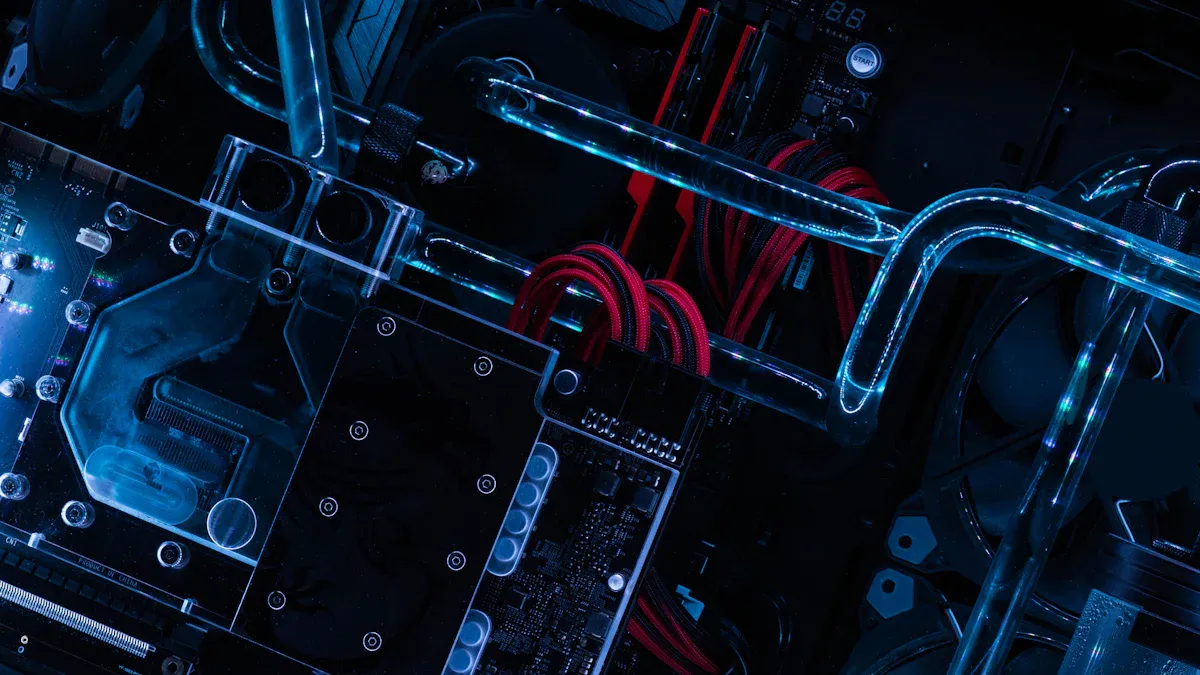

服务器赛道

Image Source: unsplash

服务器技术演进

服务器技术持续迭代,推动AI基础设施性能提升。近年来,云服务提供商对超大规模环境和生成性AI工作负载的需求显著增长。服务器架构不断优化,采用GPU、ASIC等高性能芯片,满足复杂神经网络和大型语言模型的训练需求。下表展示了服务器技术演进的关键驱动力:

| 证据来源 | 关键内容 |

|---|---|

| AI Server Market Size, Share and Trends 2025 to 2030 | AI服务器市场快速扩张,云服务商推动超大规模环境与生成性AI工作负载需求。GPU、ASIC和机器学习技术进步加速采用。 |

| AI Server Market Size, Vendor Shares, and Investment Drivers | AWS、Google、Meta、Microsoft等超大规模公司对AI服务器基础设施需求激增,推动GPU和ASIC集群投资。 |

| AI Server Market worth $837.83 billion by 2030 | 公司专注定制ASIC以优化能源效率和运营成本,尤其在重负载AI工作负载的数据中心。 |

AI芯片分类

AI服务器采用多种芯片类型,各自承担不同角色:

- GPU:擅长并行处理,主要用于AI模型训练。

- FPGA:可动态编程,适合特定AI应用场景。

- ASIC:为特定用途定制,专门支持人工智能加速。

- NPU:现代附加组件,协助CPU处理深度学习和神经网络任务。

这些芯片共同提升服务器算力,满足AI基础设施对高性能计算的需求。

产业链分工

服务器产业链结构复杂,涉及芯片设计、制造、系统集成、运维及金融服务。美国实施的关税政策和贸易限制影响半导体供应链,服务器OEM需调整策略以满足全球客户需求。部分供应商选择“美国制造”配置以规避限制。供应链不确定性导致成本转嫁或利润率下降,企业需灵活应对。BiyaPay为全球用户提供高效收付款、国际汇款、法币与数字货币实时兑换、美元T兑换美元或HKD、美股与港股交易出入金支持及数字货币交易服务,助力服务器厂商在跨境采购和资金调度中提升效率。

美股主要公司

美国市场聚集多家服务器领域领先企业:

- NVIDIA:全球GPU服务器市场领导者,推动AI训练与推理。

- AMD:提供高性能CPU与GPU,支持多元AI应用。

- Super Micro Computer:专注高密度AI服务器系统集成。

- Dell Technologies:提供定制化AI服务器解决方案。

这些公司不断创新,推动AI基础设施技术升级。

市场需求与政策

全球服务器需求持续增长,AI应用驱动架构优化。企业加速部署专为AI工作负载设计的服务器,提升能源效率与热管理能力。数据中心采用液冷与先进气流设计,满足高密度算力需求。混合部署模式兴起,结合本地服务器与云基础设施。美国政策推动本土制造与供应链安全,影响服务器产业链布局。市场对高性能、低能耗服务器的需求将持续拉动相关产业链发展。

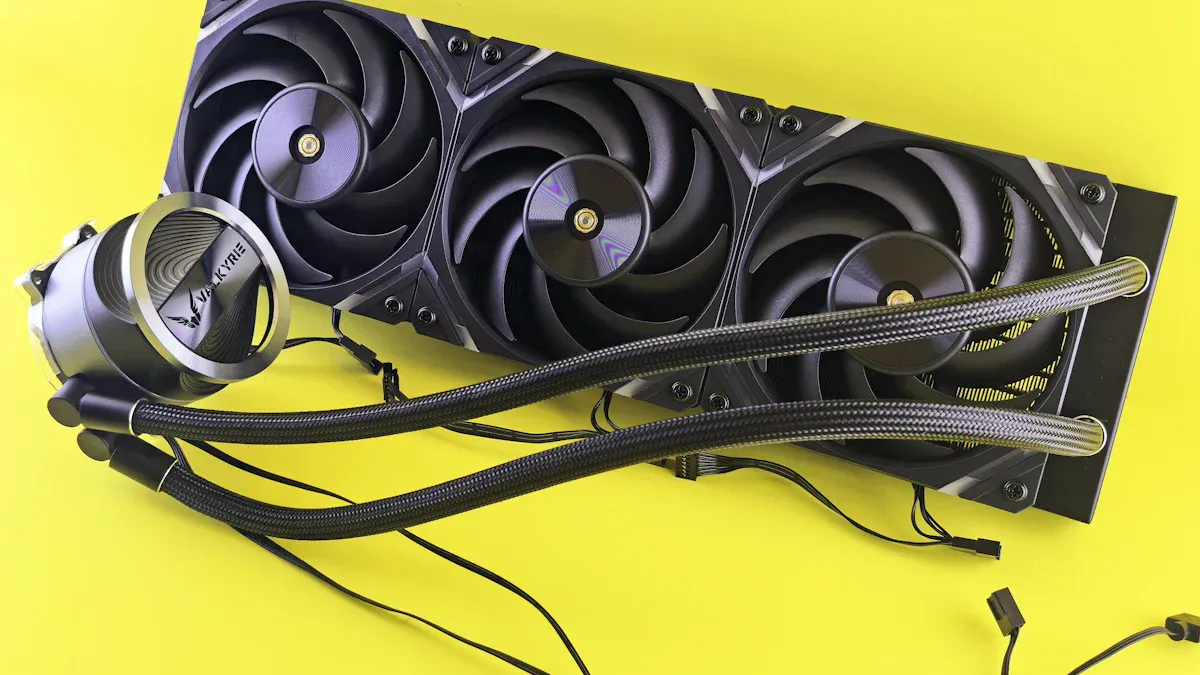

光模块赛道

Image Source: unsplash

光模块技术升级

光模块技术正经历快速迭代,推动AI基础设施实现更高带宽和能效。近年来,800G和1.6T光模块逐步成为数据中心主流,满足AI模型训练和推理对带宽的极致需求。Co-Packaged Optics(CPO)技术将光学引擎直接集成到交换机ASIC包中,显著降低功耗和延迟。下表总结了主要技术进步:

| 技术进步 | 描述 |

|---|---|

| 带宽提升 | 800G与1.6T光模块满足AI数据中心带宽需求 |

| 能效提升 | CPO技术将功耗从约30W降至9W,提高能效 |

| 集成技术 | 光学引擎与ASIC集成,减少信号损失和功耗 |

| 低延迟 | CPO技术可将延迟降低约50%,满足AI训练和推理需求 |

大型AI模型如GPT-4参数量已超一万亿,AI计算需求每3-4个月翻倍,远超摩尔定律。数据中心互连速度正从100G跃升至800G、1.6T及更高,推动新一代光模块需求持续增长。

产业链结构

光模块产业链分为组件制造、模块制造和分销集成三大层级。主要结构如下:

| 层级 | 类型 | 主要公司 |

|---|---|---|

| Tier 1 | 组件制造商 | Lumentum, II-VI Finisar, Sumitomo, Mitsubishi |

| Tier 2 | 模块制造商 | Cisco, Arista, Juniper, Innolight, Accelink |

| Tier 3 | 分销与集成 | Arrow Electronics, Avnet, Ingram Micro |

中国占据全球60-70%的光模块生产份额,台湾地区约15-20%,美国约10-15%,主要集中在高端和专业模块。企业为应对供应链风险,通常多元化采购、保持战略库存,并考虑敏感应用的本地制造。

美股主要公司

美股市场聚集多家光模块龙头企业,包括Cisco Systems、Juniper Networks、Intel Corporation、NVIDIA、Broadcom Inc.、II-VI Incorporated、Amphenol Corporation等。这些公司凭借强大的研发能力、全球制造网络和高效供应链,持续推动产品创新与市场扩张。领先企业专注于标准化光模块,降低基础设施成本,同时确保数据传输的高可靠性和速度。新兴公司则通过光子集成、微型化和节能设计等创新,积极参与市场竞争。

技术路线对比

当前主流技术路线包括800G QSFP-DD/OSFP、CPO和LPO。800G光模块已成为智能计算中心标准,未来1.6T模块将采用CPO以提升带宽密度。LPO通过去除传统DSP芯片,降低功耗和延迟,适应智能计算中心对低能耗、低延迟的需求。800G OSFP模块功耗约为16-20W,需配合液冷或优化机架散热以避免过热。NVIDIA等公司通过集成光引擎,进一步提升端口密度和能效。超大规模数据中心正积极采用这些技术,推动AI基础设施向更高性能演进。

全球竞争格局

光模块市场正处于超级周期,全球出货量和市场规模持续攀升。2024年,400G+光模块出货量预计达2040万台,2025年将超过3190万台,年均增长率高达56.5%。市场规模预计2025年达115亿美元,2035年增至476亿美元,年均增长率13.8%。中国和北美市场增长迅速,亚太地区在全球市场中占据主导地位。光模块供应链分为组件制造、模块制造和分销集成三层,企业通过多元化采购和本地制造策略应对地缘政治风险。带宽需求激增、低延迟与高能效挑战、硅光子技术加速商业化,共同驱动光模块行业进入新一轮繁荣周期,成为AI基础设施不可或缺的核心环节。

AI基础设施投资逻辑

市场空间分析

液冷、服务器与光模块三大赛道共同构建了AI基础设施的核心支柱。市场空间持续扩展,投资者关注高成长性与技术创新驱动。液冷系统市场规模预计2026年超过700亿日元,年均增长率超过50%。服务器市场受AI算力需求推动,预计2030年全球市场规模将达到8378.3亿美元。光模块行业处于超级周期,2025年市场规模预计达115亿美元,2035年增至476亿美元,年均增长率13.8%。美国市场对高性能计算和数据中心升级需求强劲,推动相关产业链快速发展。

投资者在全球资金调度和跨境采购过程中,需关注资金流动效率与汇率风险。BiyaPay为企业提供全球收付款、国际汇款、法币与数字货币实时兑换、美元T兑换美元或HKD、美股与港股交易出入金支持及数字货币交易服务,帮助企业高效完成资金结算,提升采购与项目建设效率。美国市场对AI基础设施的需求持续增长,企业通过灵活资金管理把握市场机遇。

政策与经济性

政策驱动成为AI基础设施投资的重要推手。美国等主要市场出台多项政策激励措施,推动数据中心建设与技术升级。下表总结了关键政策激励类型:

| 政策激励类型 | 具体内容 |

|---|---|

| 财务支持机制 | 启动全面的财务支持计划,包括贷款、贷款担保、补助、税收激励等。 |

| 联邦土地利用 | 指导相关部门识别并提供适合数据中心开发的联邦土地,包括军事设施。 |

| 环境审查和许可效率 | 通过现有和新的分类排除来提高环境审查和许可的效率,确保对合格项目的快速处理。 |

美国政府通过NEPA适用性和FAST-41机制加速项目审批,提升基础设施建设效率。政策要求到2025年新建大型数据中心的PUE需优于1.3,液冷技术成为确保政策合规的关键路径。经济性方面,液冷系统初始投资是空气冷却的2-3倍,但通过显著降低冷却能耗,回报期可缩短至2-3年。在10MW数据中心中,液冷解决方案(PUE 1.15)相比传统冷水解决方案(PUE 1.35)每年可节省超过200万美元的电费。液冷系统故障率比空气冷却低50%,进一步降低运营和维护成本。服务器与光模块技术升级带来能效提升,降低长期运营成本,增强投资回报率。

企业在资金管理与国际采购过程中,需关注政策合规与经济性。BiyaPay为全球用户提供实时汇率兑换、数字货币交易服务及美股与港股交易出入金支持,帮助企业应对政策变化与资金流动需求,提升投资效率。

风险与防范

投资AI基础设施面临多重风险。液体冷却系统存在泄漏风险,设计与维护不足可能导致操作失败。供应链瓶颈影响设备可用性与交付时间,AI基础设施需求增加可能导致供应链中断。政府监管挑战增加,限制技术选择与灵活性。AI数据中心可能导致24/7的集中电力需求,给电网运营带来挑战。一些数据中心增长区域经历谐波失真和负载警告,显示出电力需求的潜在风险。在华盛顿推动投资先进冷却技术的背景下,联邦政府可能介入数据中心设计决策,增加监管并使基础设施要求变得更加严格。

投资者可采取以下风险缓解策略:

| 风险缓解策略 | 说明 |

|---|---|

| 控制资源 | 拥有有形资源和掌握无形资源的企业在竞争中处于更有利的位置。 |

| 理解单位经济 | 关注投资回报率,尤其是在电力和资本成本之后的回报,而非理论上的市场总规模。 |

| 执行能力 | 能够快速交付承诺的项目,保持数据中心的正常运营和可用性,将是长期的竞争优势。 |

| 降低风险 | 通过长期合同确保收益,平衡对手方风险,并在建设时考虑灵活性,以便适应技术和需求的变化。 |

企业在全球资金调度与采购过程中,需选择高效、安全的金融服务平台。BiyaPay为用户提供全球收付款、国际汇款、法币与数字货币实时兑换、美元T兑换美元或HKD、美股与港股交易出入金支持及数字货币交易服务,帮助企业降低资金流动风险,提升资金管理灵活性。投资者需关注技术升级、政策变化与供应链安全,制定科学的风险防范策略,把握AI基础设施行业的长期价值。

未来趋势与机遇

技术创新方向

AI基础设施正迎来多项技术创新。冷板式液冷和浸没式液冷持续优化,推动数据中心能效提升。光模块领域,CPO与LPO等新型集成技术不断突破带宽和能耗瓶颈。服务器架构方面,专用AI芯片逐步取代通用GPU,优先考虑吞吐量和能效。高性能计算硬件与先进热管理系统成为新一代数据中心的核心配置。未来,边缘计算和模块化微数据中心将进一步推动本地化部署,满足实时AI推理需求。

行业整合

行业整合趋势明显。领先企业通过并购与合作,完善产业链布局,提升技术壁垒。服务器、液冷和光模块厂商加速跨界协作,推动端到端解决方案落地。供应链多元化成为应对地缘风险的重要策略。部分企业选择本地制造和战略库存,保障关键设备的持续供应。行业整合有助于提升整体创新能力和市场响应速度。

新兴应用场景

未来AI基础设施需求将由多元化应用场景驱动:

- 大型语言模型推动自然语言处理能力提升

- 实时AI推理工厂成为新型数据中心形态

- neocloud服务商专注AI计算需求

- 高性能计算专用数据中心需求增加

- 先进热管理系统成为标配

- 本地模块化微数据中心满足边缘计算

- 专用芯片优化能效与吞吐量

这些新兴场景对高性能计算硬件、热管理和电力分配提出更高要求,推动产业链持续升级。

投资建议

投资者应关注AI基础设施技术创新和行业整合带来的长期价值。美国市场对高性能计算和数据中心升级需求强劲,相关企业具备持续成长潜力。建议优先关注具备核心技术、完善供应链和高执行力的企业。资金调度和跨境采购过程中,选择高效、安全的金融服务平台有助于提升资金管理效率。投资决策需兼顾技术趋势、政策环境与供应链安全,科学把握行业机遇。

AI基础设施的三大赛道——液冷、服务器与光模块,已成为推动高性能计算和智能应用落地的核心支柱。技术演进不断突破带宽、能效与算力瓶颈,产业链升级与政策激励共同塑造了全球竞争格局。投资者需关注市场空间扩张、核心企业创新能力及技术路线演变,同时警惕供应链与能耗风险。未来,随着1.6T光模块和CPO等新技术普及,AI基础设施将持续释放价值,建议持续关注行业动态与创新突破。

FAQ

液冷技术为何成为数据中心散热主流?

液冷技术具备高效换热能力,能够显著降低能耗和提升PUE。随着AI算力密度提升,液冷方案逐步取代传统风冷,成为数据中心散热主流。

AI服务器芯片如何影响算力和能效?

AI服务器采用GPU、FPGA、ASIC、NPU等多种芯片。不同芯片类型优化并行计算、能效和吞吐量,推动AI基础设施性能持续提升。

光模块技术升级对数据中心有何影响?

光模块带宽提升至800G及以上,满足AI模型训练和推理需求。新型集成技术如CPO和LPO降低功耗和延迟,推动数据中心高效运作。

投资AI基础设施需关注哪些风险?

投资者需关注技术升级、供应链安全、政策变化及能耗风险。合理规划资金流动和采购策略,有助于降低运营和管理风险。

如何高效进行跨境资金调度与采购?

企业可选择专业金融服务平台,支持全球收付款、国际汇款、实时汇率兑换及数字货币交易。香港持牌银行场景有助于提升资金管理效率。

*本文仅供参考,不构成 BiyaPay 或其子公司及其关联公司的法律,税务或其他专业建议,也不能替代财务顾问或任何其他专业人士的建议。

我们不以任何明示或暗示的形式陈述,保证或担保该出版物中内容的准确性,完整性或时效性。